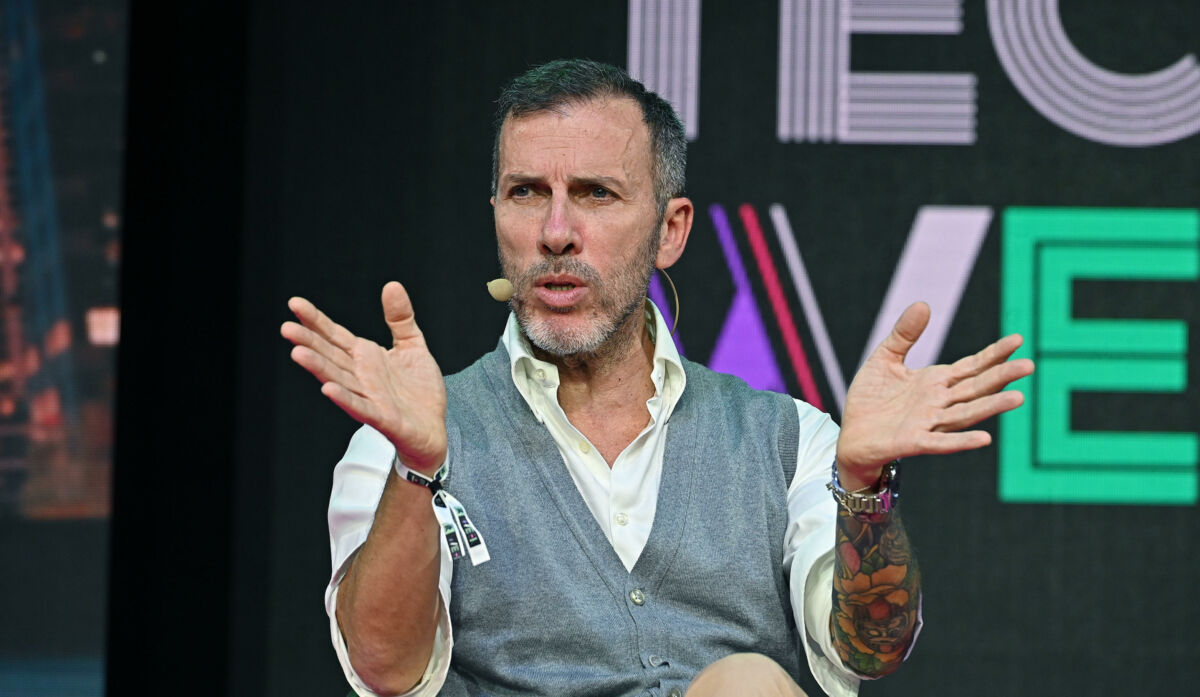

Davanti ai ragazzi adoranti radunati davanti a lui, Max Tegmark sorride. Le potenzialità dell’intelligenza artificiale sono infinite, spiega, tanto da poter immaginare uno scenario in cui l’unico limite sono le leggi della fisica. O uno meno futuribile, ma altrettanto impressionante: l’intelligenza artificiale supererà la competenza degli esseri umani nella maggior parte delle loro attuali occupazioni in pochi decenni, “forse prima, forse dopo, ma certamente nell’arco della vostra vita”, racconta il professore del Mit agli studenti radunati da diversi Paesi per il ‘Synapse’, il simposio internazionale sull’intelligenza artificiale organizzato da Bending Spoons a Milano.

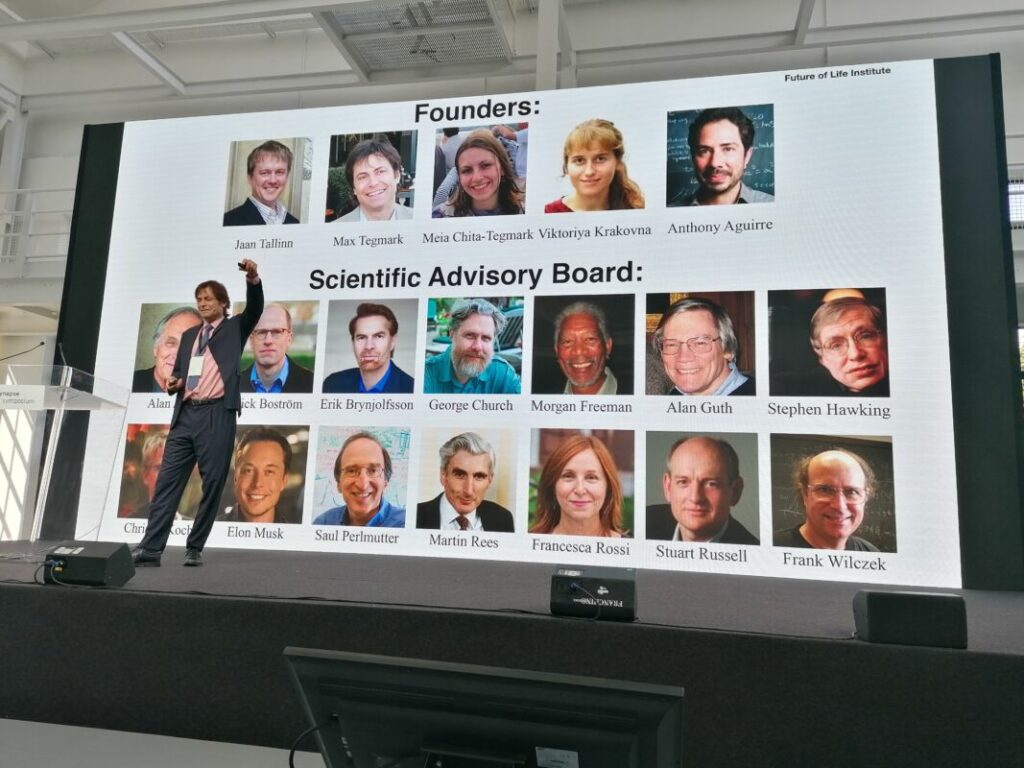

Ad aprire l’evento organizzato dalla società italiana, una dei principali app developer al mondo, famosa per l’app Immuni, è proprio Tegmark: sette anni fa, il docente al Massachusetts Institute of Technology, fisico di formazione, ha cambiato carriera, cominciando a dedicarsi all’intelligenza artificiale. Oggi è riconosciuto come un guru mondiale dell’AI, ed è il presidente del Future of Life Institute (il cui scopo è affrontare i ‘rischi esistenziali’ per l’umanità, in particolare quelli posti dell’AI).

Quello di Tegmark è il primo intervento di una giornata in cui hanno parlato professori, esperti e ricercatori. Ognuno di loro in grado di fornire una prospettiva diversa sulle nuove possibilità aperte dall’intelligenza artificiale, e sulle sfide che l’AI deve ancora superare, come l’uso della computer vision in applicazioni commerciali e le capacità predittive del comportamento umano fondamentali per lo sviluppo della guida autonoma: Federico Perazzi, Head of AI di Bending Spoons, Georgia Gkioxari, ricercatrice di Meta AI Research, Alexandre Alahi, Assistant Professor dell’EPFL in Svizzera, Luigi Di Stefano, professore dell’università di Bologna, Vittorio Ferrari, Senior Staff Research Scientist di Google in Svizzera, e Michele Catasta, Head of applied research di ‘X, the moonshot factory’ (precedentemente conosciuta come Google[x]).

Lo scopo dell’evento, nelle intenzioni di Bending Spoons, è accendere il dibattito sul tema dell’intelligenza artificiale, che in altri Paesi è sicuramente più avanzato, e avvicinare gli studenti alla materia.

Intelligenza artificiale: una conoscenza immensa, nelle mani di pochi

Per questo Luca Ferrari, l’AD di Bending Spoons, sottolinea l’importanza di svolgere Synapse in Italia, “piuttosto che in uno dei pochi paesi dove si concentrano maggiormente la conoscenza e il controllo dell’intelligenza artificiale. Speriamo che questo evento possa aiutare a accendere un movimento che miri ad introdurre un sistema globale tale da massimizzare le probabilità che l’intelligenza artificiale renda il nostro mondo più equo e inclusivo di quanto lo sia mai stato prima” ha detto l’Ad di Bending Spoons, che utilizza già l’intelligenza artificiale all’interno delle sue app, in particolare per quelle che si occupano di creazione di contenuti, per esempio nel miglioramento della qualità di immagini, grazie a effetti che non sarebbe possibile raggiungere senza la tecnologia offerta dall’intelligenza artificiale.

Davanti alla platea di studenti e giovani ingegneri informatici selezionati nei mesi scorsi per partecipare all’evento, Ferrari ha spiegato quanto sia evidente la mancanza di figure qualificate nel settore e quanto sia importante colmare il gap, perché anche in Italia la ricerca possa andare avanti. “Purtroppo al momento le conoscenze sull’intelligenza artificiale sono concentrati in poche mani e, a meno che non facciamo qualcosa in proposito, questa concentrazione aumenterà in futuro”, dice Ferrari.

“Se le persone che posseggono gli strumenti più potenti per l’utilizzo dell’intelligenza artificiale decideranno di utilizzare la loro posizione di potere per scopi contrari al benessere dell’umanità, andremo verso un futuro di estreme diseguaglianze e assolutamente non inclusivo”.

Il futuro secondo Tegmark: dall’AI all’AGI

Tegmark spiega lo scenario AI con tre concetti: ‘power’, cioè la potenza dell’intelligenza artificiale e del machine learning. ‘Destination’, cioè l’obiettivo al quale l’AI è indirizzata. Ma, soprattutto, il concetto di ‘steering’: la macchina, per quanto potente, va guidata, e sono gli umani a dover sterzare, a dover fare in modo che gli obiettivi dell’intelligenza artificiale (la ‘destination’) siano allineati a quelli dell’umanità.

“Personalmente credo che l’unico modo per garantire che l’AI sarà per il bene di tutti è che tutti abbiano voce in capitolo su come viene utilizzata”, dice il professore.

“La chiave siete voi”, dice agli studenti. “Vorrei incoraggiarvi a immaginare come l’AI può essere sviluppata in modo che rimanga allineata con ciò che è effettivamente buono per tutte le persone”. Lo steering, ancora una volta: gli umani dovranno guidare una macchina sempre più potente.

Uno degli studenti chiede preoccupato se vale la pena costruirla, l’AI del futuro, visto che non siamo sicuri se potremo controllarla.

Un’AI che un giorno si trasformerà in AGI, artificial general intelligence, in grado di svolgere qualsiasi compito meglio degli umani. Paradossalmente, anche lo sviluppo software. Basta guardare i progressi fatti nel settore da Google Palm, di cui ha parlato durante l’evento Michele Catasta di ‘X, the moonshot factory’.

La risposta allo studente preoccupato (e a tutti quelli preoccupati come lui), naturalmente, è complessa.

Andiamo sempre più velocemente incontro a un futuro in cui qualsiasi lavoro potrà essere eseguito da un’intelligenza artificiale meglio di quanto facciano gli umani, e il professore avverte gli studenti che succederà nei prossimi decenni, “nell’arco delle vostre vite”.

Ma Tegmark chiarisce che la rivoluzione AI, qualsiasi cosa facciamo, “is happening”: è arrivata e continuerà, anche perché gli interessi economici, scientifici e sociali che la sostengono sono ormai troppo grandi per poter tirare il freno a mano.

Solo in Italia, secondo l’osservatorio AI del Polimi, siamo arrivati a un giro d’affari da 380 mln di euro, con una crescita del 21% nel 2021.

Allora il focus non è più come fermare la crescita dell’AI, ma come accelerare la crescita della “wisdom”, la saggezza con cui quell’accelerazione va gestita: “Non possiamo rallentare la crescita del ‘power’, quindi, ma dobbiamo accelerare la crescita della saggezza. Dobbiamo investire di più nella ricerca, dobbiamo discutere di più su come regolamentare l’AI”, dice il professore lodando lo sforzo normativo dell’Ue, che sta lavorando in questi mesi sull’AI Act.

Lavorare su regole comuni è fondamentale perché l’Ai non deve essere solo affidabile, ma anche etica: dovremmo fidarci delle macchine solo perché capiamo come funzionano? Un’intelligenza artificiale è affidabile se obbedirà al suo proprietario. Ma sarà etica? “Dobbiamo avere una conversazione molto seria nella società su come allineare gli obiettivi delle persone e delle aziende che hanno questa tecnologia”, dice Tegmark, “per garantire che la usino per il bene della società nel suo complesso. Dobbiamo assicurarci che le macchine che costruiamo siano per il bene dell’umanità. E dobbiamo avere lo stesso approccio con le aziende che controllano le macchine”.

Il risvolto peggiore dell’intelligenza artificiale (e come evitarlo): gli slaughterbots

Tegmark è autore di 250 pubblicazioni e libri come Life 3.0: Being Human in the Age of Artificial Intelligence: uno dei libri preferiti di Elon Musk, al quale Tegmark è molto vicino: Musk fa parte del board del Future of life institute.

Il Ceo di Tesla condivide le preoccupazioni del professore sui pericoli dell’AI, diventati particolarmente concreti: in passato Tegmark ha parlato dei pericoli degli ‘slaughterbots’, piccoli droni guidati dall’AI che potrebbero attaccare addirittura in sciami. Una specie di arma di distruzione di massa, come le armi nucleari?

“Peggio”, dice Tegmark a Fortune Italia, durante una pausa dell’evento (mentre affronta le domande delle ragazze e dei ragazzi presenti). Per comprare un’arma nucleare servono tanti, tanti soldi, e parliamo prettamente del mondo militare. Montare un sistema AI su un drone, dice Tegmark, non è poi così costoso. “Se vuoi uccidere un milione di persone con le armi, ti serve un esercito, dice il professore. Se usi i droni, ti basta una persona con un laptop in mano”. E verranno usati non solo dagli eserciti, ma anche dai gruppi criminali, ricorda il professore.

Jalisco Cartel, Nueva Generación dropping small bombs from a drone on a target in Michoacán, Mexico.

People can be seen running away after the bombs hit the camp. #Mexico pic.twitter.com/5pYtg1V9B4— CNW (@ConflictsW) January 11, 2022

“Non sono contro l’utilizzo dell’AI nel mondo militare”, dice Tegmark, perché “può essere utilizzata per soluzioni positive, ad esempio per l’individuazione di mine”. Ma “se guardiamo a qualsiasi tecnologia ci sono applicazioni negative, e in tempi di guerra ci sono tecnologie che possono essere un fattore stabilizzante per applicazioni militari oppure essere usate per attaccare i civili. Ma si può stabilire di non usarle, come nel caso delle armi biologiche, che sono bandite. Credo che per l’AI il discorso sia lo stesso. Credo che nessuno alla fine voglia delle armi talmente efficaci ed economiche da permettere che chiunque possa usarle per attaccare il tuo presidente”. Un’argomentazione usata dal Future of life institute per spingere su un ban agli sciami di droni intelligenti.

“Ci sono state molte discussioni internazionali sugli slaughterbots”, dice Tegmark, riferendosi ai droni programmabili per uccidere il proprio obiettivo. “Purtroppo, i negoziati su questo tema alle Nazioni Unite a Ginevra sono state bloccate da Paesi come Russia e Stati Uniti”. Molti Paesi, infatti, vogliono che armi del genere vengano bandite, ma diversi Stati si sono per il momento opposti a restrizioni legalmente vincolanti.

Secondo Tegmark, “questo non significa che siamo condannati. C’è spazio per essere ottimisti. Se delle regole sono state fatte per altri tipi di armi, potranno essere implementate anche per l’AI”.