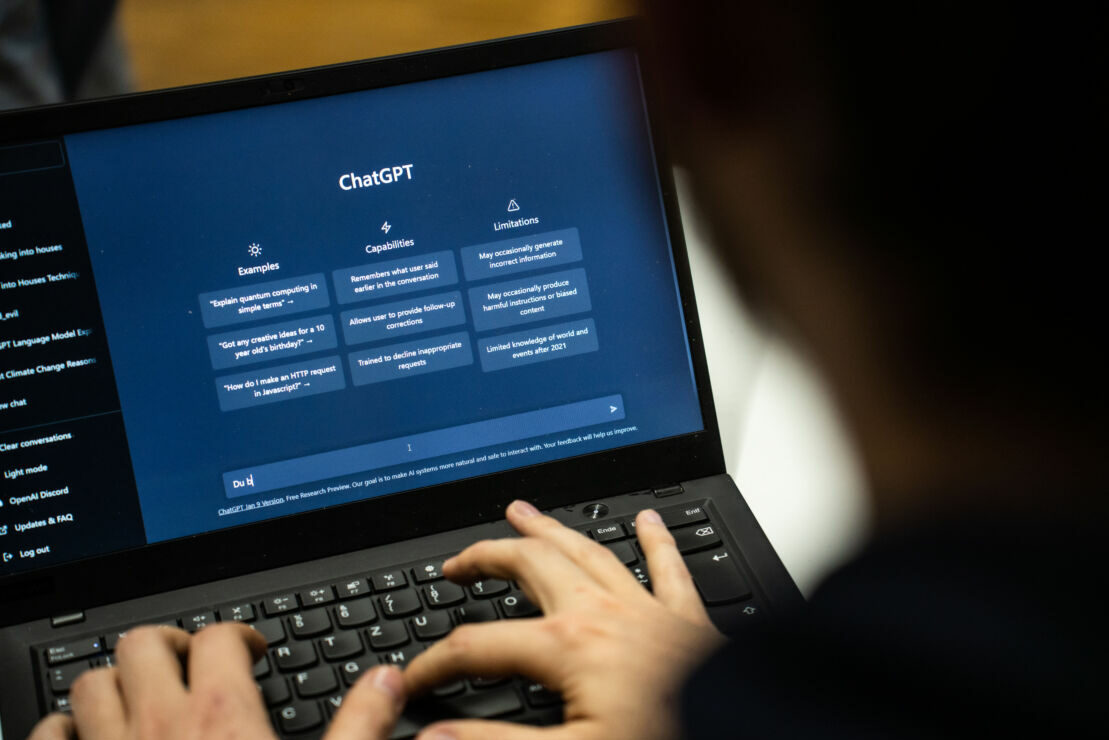

Arriva l’ok del Parlamento europeo all’AI Act, e l’Europa è sempre più vicina a dare vita al primo set di regole al mondo dedicato all’intelligenza artificiale. Il passo compiuto oggi sarà fondamentale per un ampio raggio di applicazioni, che vanno dalla biometria all’AI generativa di ChatGpt: il testo, che ha l’obiettivo di fornire gli standard di un settore che è in continua evoluzione, è stato approvato con 499 voti a favore, 29 contrari e 93 astenuti.

Ecco alcuni dei punti principali del regolamento approvati dall’Aula di Strasburgo:

- Il divieto dell’uso dell’intelligenza artificiale per attività di sorveglianza biometrica, per il riconoscimento delle emozioni e per utilizzi di polizia predittiva.

- La determinazione di un ‘alto rischio’ per i sistemi di AI utilizzati, potenzialmente, per influenzare gli elettori nelle elezioni.

- L’obbligo di dichiarare come è stato generato il contenuto per i sistemi di AI generativa come ChatGPT.

Questo ultimo punto era forse quello più atteso dai fan dei chatbot super intelligenti introdotti da OpenAI grazie ai suoi modelli linguistici: recentemente, Sam Altman, Ceo di OpenAI, ha detto che la società che ha sguinzagliato ChatGpt nel mondo potrebbe pensare di abbandonare l’Europa, nel caso le regole fossero troppo stringenti. Anche se comunque, secondo le parole di Altman riportate dal Financial Times, OpenAI cercherà di adeguarsi alle regole.

Un primo stop alla creatura di Altman era arrivato proprio dall’Italia, a opera del Garante della privacy. Dopo il chiarimento con il Garante, a fine aprile, ChatGpt era tornato online in Italia dopo una ‘pausa’ di qualche settimana.

Secondo Alessandro Piva, direttore dell’Osservatorio sull’intelligenza artificiale del Politecnico di Milano, “quello compiuto oggi è un passo importante, anche se i punti principali erano contenuti nelle bozze precedenti: il principio di trattare l’intelligenza artificiale sulla base dell’analisi del rischio”, ad esempio, “e poi ovviamente le novità sull’Ai generativa, che cercano di mettere ordine in quello che è un elemento nuovo negli aspetti non tanto tecnologici, ma negli utilizzi”.

Dal punto di vista delle conseguenze per ChatGpt e per i concorrenti passerà del tempo, spiega Piva. Sugli adeguamenti necessari alle norme europee, però, potrebbero essere fatti “dei grossi passi in avanti all’interno di questi servizi. Diciamo che il destino di alcune linee guida rappresentate oggi all’interno del testo ovviamente dipenderà dall’effettiva capacità di applicare queste regole e dal dibattito che si verrà a creare con questi soggetti. Alcuni elementi saranno difficili da controllare: gli aspetti sulla tutela del copyright, ad esempio. E comunque bisognerà trovare un punto di equilibrio, anche a confonto con una prospettiva globale e non solo europea, per evitare che poi le aziende fuggano dai nostri Paesi”.

Secondo Piva, sull’intelligenza artificiale generativa bisognerà “aprire un tavolo di confronto continuativo con questi soggetti, e il fatto che si sia fatto un passo in avanti di questo tipo significa che si sta andando nella direzione giusta, nella comprensione del problema. È chiaro che accanto a ChatGpt compariranno tanti altri attori che andranno più direttamente sui processi aziendali: in quel caso sarà più difficile controllare tutto il loro operato”.

Le regole per ChatGpt e l’AI generativa

La bozza originaria delle regole europee sull’intelligenza artificiale risale al 2021, prima che l’AI generativa ottenesse l’importanza che ha poi acquistato nell’ultimo anno, con l’arrivo di ChatGpt. Per questo il testo approvato oggi dal Parlamento dedica a ChatGpt e colleghi (cioè, appunto, i sistemi di AI generativa) delle regole specifiche.

Regole che tra le altre cose impongono di rispettare i requisiti di trasparenza: bisognerà sempre dichiarare che i contenuti sono stati generati dall’AI, e dovrà essere possibile distinguere le immagini deep-fake da quelle reali, mentre saranno necessarie “salvaguardie per evitare la generazione di contenuti illegali”.

Per quanto riguarda il copyright, e questo è forse il punto più complesso, “dovrebbero inoltre essere pubblicate le sintesi dettagliate dei dati protetti dal diritto d’autore utilizzati per l’addestramento” degli algoritmi, dice il Parlamento.

I fornitori di modelli linguistici come OpenAI, dice il Parlamento “dovrebbero valutare e mitigare i possibili rischi (alla salute, alla sicurezza, ai diritti fondamentali, all’ambiente, alla democrazia e allo Stato di diritto) e registrare i loro modelli nella banca dati dell’UE prima della loro immissione sul mercato europeo”.

Brando Benifei, correlatore del testo e capo delegazione Pd a Strasburgo, ha ricordato la lettera degli esperti Ue sui rischi dell’intelligenza artificiale, firmata anche da Sam Altman: “Oggi tutti gli occhi sono puntati su di noi. Mentre le Big Tech lanciavano l’allarme per le loro creazioni, l’Europa è andata avanti e ha proposto una risposta concreta ai rischi che l’AI sta iniziando a rappresentare. Vogliamo che il potenziale creativo e produttivo dell’AI venga sfruttato. Tuttavia, durante i negoziati con il Consiglio ci batteremo per proteggere la nostra posizione e contrastare i pericoli per la democrazia e la libertà”.

Il correlatore Dragos Tudorache (Renew, Romania) ha aggiunto: “La legge sull’intelligenza artificiale stabilirà uno standard a livello mondiale per lo sviluppo e la governance dell’intelligenza artificiale, assicurando che questa tecnologia – destinata a trasformare radicalmente le nostre società grazie agli enormi benefici che può offrire – si evolva e venga utilizzata nel rispetto dei valori europei della democrazia, dei diritti fondamentali e dello Stato di diritto”.

AI Act approvato: cosa succede ora?

Quanto manca prima di vedere le regole sull’intelligenza artificiale entrare in vigore?

Innanzitutto, ora inizia la fase di negoziazione con Commissione europea e Consiglio europeo, che si concluderà con ogni probabilità non prima della fine del 2023, e che inizierà già nella giornata di approvazione dell’AI Act a Strasburgo.

Una volta raggiunto l’accordo nella fase negoziale (i triloghi), di norma passa del tempo prima della entrata in vigore. È probabile quindi che l’AI Act non entri in vigore prima della fine del 2025.

Intanto, Ue e Usa sarebbero al lavoro a un codice di condotta, di applicazione più facile (perchè su base volontaria) ma sicuramente non altrettanto integrale: una bozza, non ancora svelata, è stata annunciata a fine maggio dalla vicepresidente della Commissione Ue, Margrethe Vestager, e dal segretario di Stato americano Antony Blinken.

AI Act, cosa dice il regolamento

Le regole approvate dal Parlamento hanno alla base 4 livelli di rischio (da minimo a inaccettabile) che i sistemi AI possono generare. Ad esempio, tutte le applicazioni con un rischio “inaccettabile” per la sicurezza delle persone sono vietate: i sistemi AI per il punteggio sociale, che classificano le persone in base al loro comportamento sociale o alle loro caratteristiche, saranno severamente vietati.

Ma tra i divieti decisi dal Parlamento ci sono anche i sistemi di identificazione biometrica remota “in tempo reale” e “a posteriori” in spazi accessibili al pubblico, e quelli che applicano una categorizzazione basata su genere, razza, etnia, cittadinanza, religione, orientamento politico.

Vietati anche i sistemi di polizia predittiva (basati su profilazione, ubicazione o comportamenti criminali passati), di riconoscimento delle emozioni (utilizzati dalle forze dell’ordine) e utilizzati nella gestione delle frontiere, nel luogo di lavoro e negli istituti d’istruzione.

Vietato anche lo ‘scraping’ applicato alle informazioni biometriche, ovvero “l’estrazione non mirata di dati biometrici da Internet o da filmati di telecamere a circuito chiuso per creare database di riconoscimento facciale (in violazione dei diritti umani e del diritto alla privacy)”, dice il Parlamento europeo.

Dopo le AI inaccettabili, ci sono anche quelle ad alto rischio: il testo approvato dai deputati europei in questa categoria mette le AI che “comportano danni significativi per la salute, la sicurezza, i diritti fondamentali delle persone o l’ambiente”. A questa categoria sono stati aggiunti i sistemi di intelligenza artificiale utilizzati per influenzare gli elettori e l’esito delle elezioni e i sistemi di raccomandazione utilizzati dalle piattaforme di social media che abbiano oltre 45 milioni di utenti.

Il peso delle regole sull’innovazione AI

Il Parlamento sembra essere consapevole del fatto che l’imposizione di regole potrebbe trasformarsi in un boomerang, dal punto di vista della competitività europea nel campo dell’intelligenza artificiale. Se, come ha paventato Altman, le aziende dell’AI abbandonassero il continente, il pallino del gioco sarebbe definitivamente in mano a Stati Uniti e Cina.

Per stimolare l’innovazione nel settore e sostenere le PMI, però, i deputati hanno previsto “esenzioni per le attività di ricerca e le componenti dell’AI fornite con licenze open-source”. La nuova legge promuove i cosiddetti “spazi di sperimentazione normativa, o ambienti di vita reale, creati dalle autorità pubbliche per testare l’AI prima che venga implementata”, dice il Parlamento.

Infine, “i deputati intendono rafforzare il diritto dei cittadini di presentare reclami sui sistemi di AI e di ricevere spiegazioni sulle decisioni basate su sistemi di IA ad alto rischio con un impatto significativo sui loro diritti fondamentali. I deputati hanno anche riformato il ruolo dell’Ufficio dell’UE per l’AI, che avrà il compito di monitorare l’attuazione delle norme sull’AI”.

“Abbiamo fatto la storia”, ha detto la presidente dell’Eurocamera, Roberta Metsola, nella conferenza stampa a Strasburgo dopo il via libera alle nuove regole per l’intelligenza artificiale. “L’Eurocamera ha trovato un impostazione equilibrata e centrata sulle persone per una legalizzazione che stabilirà uno standard globale per molti anni. Possiamo essere fieri del ruolo leader dell’Ue in questo settore”.

Andrea Monti: la paura del vuoto legislativo potrebbe rallentare lo sviluppo dell’AI